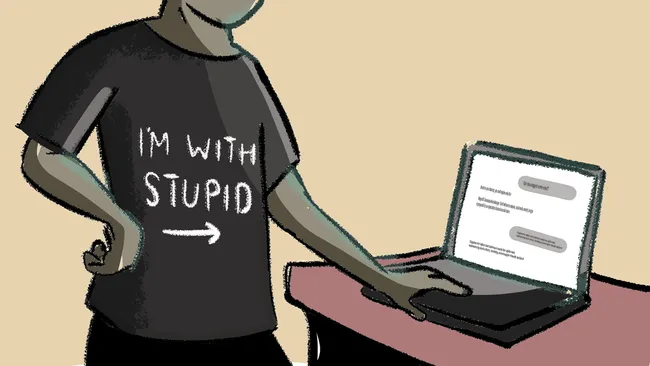

Pesquisadores descobriram que a IA achata a curva normal de um princípio comum na psicologia humana, conhecido como efeito Dunning-Kruger, dando a todos nós a ilusão de competência.

Com informações de Live Science.

Quando solicitados a avaliar nossa capacidade em algo, tendemos a errar completamente nessa estimativa. É uma tendência humana universal, com o efeito sendo mais acentuado em pessoas com níveis de habilidade mais baixos. Chamado de efeito Dunning-Kruger, em homenagem aos psicólogos que o estudaram pela primeira vez, esse fenômeno significa que pessoas que não são muito boas em uma determinada tarefa são excessivamente confiantes, enquanto pessoas com alta capacidade tendem a subestimar suas habilidades. Isso geralmente é revelado por testes cognitivos — que incluem problemas para avaliar atenção, tomada de decisão, julgamento e linguagem.

Mas agora, cientistas da Universidade Aalto, na Finlândia (juntamente com colaboradores da Alemanha e do Canadá), descobriram que o uso da inteligência artificial (IA) praticamente elimina o efeito Dunning-Kruger — na verdade, quase o reverte.

A pesquisa mostrou que, ao usar chatbots comuns para resolver problemas, todos (independentemente do nível de habilidade) tendiam a depositar muita fé na qualidade das respostas, sendo os usuários mais experientes em IA os que mais o faziam. A equipe publicou suas descobertas na edição de fevereiro de 2026 da revista Computers in Human Behavior.

À medida que nos tornamos mais familiarizados com IA graças à proliferação de grandes modelos de linguagem (LLMs), os pesquisadores esperavam que os participantes não apenas interagissem melhor com sistemas de IA, mas também avaliassem melhor seu desempenho ao usá-los. “Em vez disso, nossas descobertas revelam uma incapacidade significativa de avaliar o próprio desempenho com precisão ao usar IA, de forma igualitária em nossa amostra”, disse Robin Welsch, cientista da computação da Universidade Aalto e coautor do relatório, em um comunicado.

Achatar a curva

No estudo, cientistas deram a 500 participantes tarefas de raciocínio lógico do Teste de Admissão à Faculdade de Direito (LSAT), sendo que metade deles pôde usar o popular chatbot de IA ChatGPT. Posteriormente, ambos os grupos foram questionados sobre seu conhecimento de IA e sobre a qualidade de seu próprio desempenho, com a promessa de uma compensação extra caso avaliassem seu desempenho corretamente.

Os motivos por trás dessas descobertas são variados. Como os usuários de IA geralmente se contentavam com a resposta após apenas uma pergunta ou sugestão, aceitando-a sem verificação ou confirmação adicional, pode-se dizer que eles se envolveram no que Welsch chama de “descarregamento cognitivo” — questionando a questão com menos reflexão e abordando-a de uma maneira mais “superficial”.

Menos envolvimento em nosso próprio raciocínio — o que chamamos de “monitoramento metacognitivo” — significa que ignoramos os ciclos usuais de feedback do pensamento crítico, o que reduz nossa capacidade de avaliar nosso desempenho com precisão.

Ainda mais revelador foi o fato de que todos nós superestimamos nossas habilidades ao usar IA, independentemente da nossa inteligência, com a diferença entre usuários com alta e baixa habilidade diminuindo. O estudo atribuiu isso ao fato de que os LLMs ajudam todos a terem um desempenho melhor até certo ponto.

Embora os pesquisadores não tenham se referido a isso diretamente, a descoberta também surge em um momento em que os cientistas começam a questionar se os modelos de liderança de liderança (LLMs) comuns não são excessivamente bajuladores. A equipe da Aalto alertou para diversas ramificações potenciais à medida que a IA se torna mais difundida.

Em primeiro lugar, a precisão metacognitiva geral pode ser prejudicada. À medida que nos baseamos mais nos resultados sem questioná-los rigorosamente, surge uma compensação em que o desempenho do usuário melhora, mas a percepção de quão bem nos saímos nas tarefas diminui. Sem refletir sobre os resultados, verificar erros ou raciocinar de forma mais profunda, corremos o risco de comprometer nossa capacidade de obter informações de forma confiável, afirmaram os cientistas no estudo.

Além disso, o achatamento do Efeito Dunning-Kruger significa que todos continuaremos a superestimar nossas habilidades ao usar IA, sendo que os mais familiarizados com IA farão isso ainda mais — o que levará a um aumento de decisões equivocadas e à erosão de habilidades.

Um dos métodos sugeridos pelo estudo para conter esse declínio é fazer com que a própria IA incentive os usuários a fazerem mais perguntas, com os desenvolvedores reorientando as respostas para estimular a reflexão — literalmente fazendo perguntas como “quão confiante você está nesta resposta?” ou “o que você pode ter deixado passar?”, ou promovendo maior interação por meio de métricas como pontuações de confiança.

A nova pesquisa reforça ainda mais a crescente crença de que, como argumentou recentemente a Royal Society , o treinamento em IA deve incluir pensamento crítico, e não apenas habilidade técnica. “Nós… oferecemos recomendações de design para sistemas interativos de IA a fim de aprimorar o monitoramento metacognitivo, capacitando os usuários a refletir criticamente sobre seu desempenho”, afirmaram os cientistas.