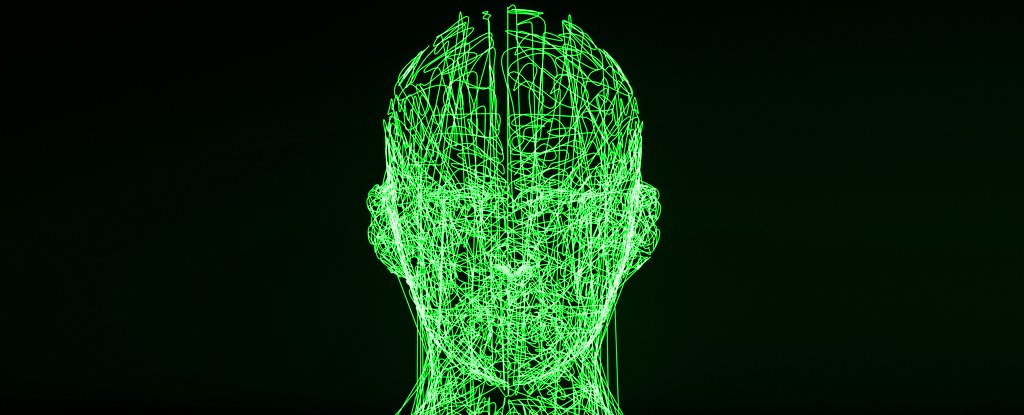

Como O Terminator poderia ter se agido se a Skynet tivesse decidido que provavelmente não era responsável o suficiente para segurar as chaves de todo o arsenal nuclear dos EUA? Os cientistas podem estar nos salvando de um futuro apocalipse liderado pela IA, criando redes neurais que sabem quando não são confiáveis.

Com informações do Science Alert.

As redes neurais de aprendizado profundo são projetadas para imitar o cérebro humano ao pesar uma infinidade de fatores em equilíbrio entre si, identificando padrões em massas de dados que os humanos não têm a capacidade de analisar.

Embora a Skynet ainda esteja um pouco distante, a IA já está tomando decisões em áreas que afetam vidas humanas, como direção autônoma e diagnóstico médico, e isso significa que é vital que sejam o mais precisas possível. Para ajudar nesse objetivo, este sistema de rede neural recém-criado pode gerar seu nível de confiança, bem como suas previsões.

“Precisamos da capacidade não apenas de ter modelos de alto desempenho, mas também de entender quando não podemos confiar nesses modelos”, diz o cientista da computação Alexander Amini, do Laboratório de Ciência da Computação e Inteligência Artificial do MIT (CSAIL).

Essa autoconsciência de confiabilidade recebeu o nome de Deep Evidential Regression e baseia sua pontuação na qualidade dos dados disponíveis com os quais deve trabalhar – quanto mais precisos e abrangentes forem os dados de treinamento, mais provável será que as previsões futuras vão dar certo.

A equipe de pesquisa o compara a um carro que dirige sozinho, com diferentes níveis de certeza sobre se deve passar por um cruzamento ou esperar, apenas no caso, se a rede neural estiver menos confiante em suas previsões. A classificação de confiança inclui até dicas para aumentar a classificação (ajustando a rede ou os dados de entrada, por exemplo).

Embora proteções semelhantes tenham sido construídas em redes neurais antes, o que a diferencia é a velocidade com que funciona, sem demandas excessivas de computação – pode ser concluída em uma corrida pela rede, em vez de várias, com um nível de confiança gerado em ao mesmo tempo que uma decisão.

“Essa ideia é importante e amplamente aplicável”, diz a cientista da computação Daniela Rus. “Ele pode ser usado para avaliar produtos que dependem de modelos aprendidos. Ao estimar a incerteza de um modelo aprendido, também aprendemos quanto erro esperar do modelo e quais dados ausentes podem melhorar o modelo.”

Os pesquisadores testaram seu novo sistema fazendo com que ele avaliasse as profundidades em diferentes partes de uma imagem, da mesma forma que um carro autônomo pode avaliar a distância. A rede se comparou bem às configurações existentes, ao mesmo tempo em que estimou sua própria incerteza – os momentos em que era menos certa foram, de fato, os momentos em que errou nas profundidades.

Como um bônus adicional, a rede foi capaz de sinalizar os momentos em que encontrou imagens fora de sua área de atuação normal (muito diferentes dos dados em que foi treinada) – o que em uma situação médica pode significar pedir a um médico para dar uma segunda opinião.

Mesmo que uma rede neural esteja certa 99% das vezes, esse 1% ausente pode ter consequências graves, dependendo do cenário. Os pesquisadores afirmam estar confiantes de que seu novo teste de confiança simplificado pode ajudar a melhorar a segurança em tempo real, embora o trabalho ainda não tenha sido revisado por pares.

“Estamos começando a ver muito mais desses modelos [de rede neural] saindo do laboratório de pesquisa e entrando no mundo real, em situações que afetam humanos com consequências potencialmente fatais”, disse Amini.

“Qualquer usuário do método, seja um médico ou uma pessoa no banco do passageiro de um veículo, precisa estar ciente de qualquer risco ou incerteza associada a essa decisão”.

A pesquisa está sendo apresentada na conferência NeurIPS em dezembro, e um artigo online está disponível.